著者:蘇揚、テンセント・テクノロジー

5月8日、OpenAIはAPIに3つの次世代音声モデルを追加した。音声推論と対話を主軸とするGPT-Realtime-2、リアルタイム多言語翻訳を特徴とするRealtime-Translate、そして音声テキスト変換に特化したRealtime-Whisperである。

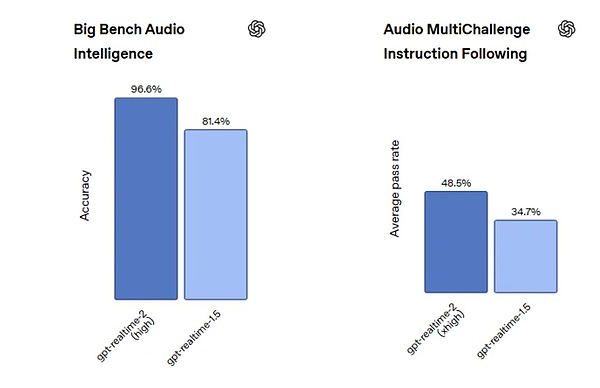

GPT-Realtime-2は、OpenAI初のGPT-5レベルの推論能力を備えた音声モデルです。ベンチマークテストにおいて著しい進歩を示しており、Big Bench AudioBig Bench AudioAudio MultiChallengeコマンド遵守評価における平均合格率は96.6%に達し、Audio MultiChallengeコマンド遵守評価における平均合格率は48.5%で、前世代のGPT‑Realtime‑1.5と比較してそれぞれ15.2ポイントおよび13.8ポイント向上した。

GPT-Realtime-2を基盤として、音声AIは単純なターン制の質疑応答から、会話の展開中に継続的に聞き取り、推論し、ツールを呼び出してタスクを完了できる形態へと進化しました。

「考える」音声アシスタント

GPT-Realtime-2の設計目標は、会話の流暢さを維持しつつ、複雑なタスクを処理するために必要な推論能力と行動能力を音声モデルに備えさせることです。

対話の自然さに関して、モデルは導入文メカニズムを導入しました。

開発者は、「確認します」や「少々お待ちください、確認中です」といった短いメッセージを表示することで、正式な応答が生成される前に、リクエストが受信され処理中であることをユーザーに知らせることができます。

これと連動して並行ツール呼び出しおよびツールの透過性機能により、モデルは複数の外部ツールを同時に呼び出すことができ、音声を通じてユーザーに現在の進捗状況を通知します。例えば、「カレンダーを確認しています」や「検索中です」と発話することで、エージェントがタスクを完了する過程で沈黙に陥ることなく、常に応答し続けます。

処理が困難な状況に遭遇した場合、モデルは「現在少し問題が発生しています」といったメッセージを能動的に表示し、回復を試みます。黙って失敗したり、セッションを直接中断したりすることはありません。

さらに、モデルのコンテキストウィンドウが32Kから128Kに拡張されました。これにより、より長く複雑な複数ラウンドの対話においても一貫性を保ち、より完全なエージェントワークフローを支えることが可能になります。

専門的なシナリオでの適用性に関しては、モデルは特定分野の用語に対する理解力を強化し、専門用語、固有名詞、医学用語をより正確に保持できるようになりました。これは、本番環境での導入において顕著な価値があります。表現の面では、モデルはより制御可能な口調と表現力を持ち、状況に応じてスタイルを切り替えることができます。

もう一つの重要なアップグレードは調整可能な推論強度。開発者は、遅延と推論の深さのバランスをとるために、minimal、low、medium、high、xhighの5つのレベルから選択できます(デフォルトはlow)。

無駄話なし

GPT-Realtime-2はベンチマークテストで前世代モデルを圧倒

音声モデルの高度な推論能力を評価するBig Bench Audio評価において、GPT-Realtime-2(high推論レベル)は96.6%の精度を達成し、GPT-Realtime-1.5の81.4%から15.2ポイント向上しました。

会話型システムにおける複数ラウンドの対話知能を評価するAudio MultiChallenge評価において——この評価は、指示の遵守、文脈の統合、自己一貫性、および自然な音声による訂正の処理などの側面を網羅しています—GPT-Realtime-2(xhigh推論レベル)の平均合格率は、GPT-Realtime-1.5の34.7%から48.5%へと跳ね上がり、相対的に13.8ポイント向上しました。

実際、音声モデルが真に「賢い」かどうかを測る上で、最も説得力のあるシナリオは雑談ではなく、多層的な推論を必要とする複雑な問題への対処である。

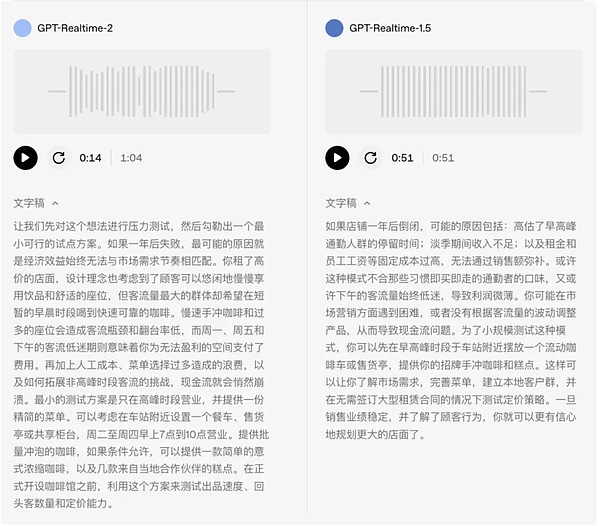

注:OpenAIはデモ資料の中で具体的なテスト例を示しています。ユーザーがモデルに自身の起業について説明し、2世代のリアルタイムモデルによる音声推論とそれに対応するテキストスクリプト

上記の事例は、推論能力に高い要求が課される複合的なタスクに属します。モデルは複数の変数の相互関係を同時に理解する必要があり、客足の時間的な分布の不均一さ、高額な固定賃料コスト、そして「スローコーヒー」を主力とするような回転率の低い業態という位置づけを同時に理解し、これらの制約条件の下で論理的な推論を行う必要があります。

GPT-Realtime-2は1分04秒で、論理的かつ階層的な回答を提示した。客足の変動と賃料構造の矛盾を分析し、ピーク時間帯への集中が全体的な坪単価を賃料のカバーに不足させる可能性を指摘しただけでなく、具体的な軽量テストの道筋も提案した。

同じ質問を前世代のモデルであるGPT-Realtime-1.5に投げかけたところ、回答時間は51秒でしたが、その深さは明らかに不足していました。この比較デモは、戦略的推論の次元における2世代のモデルの世代間格差を如実に示しています。

03 リアルタイム翻訳と文字起こし

GPT-Realtime-2に加え、OpenAIが同時にリリースした2つの専用モデルは、それぞれ明確なシナリオのニーズに対応しています。

GPT‑Realtime‑Translateはリアルタイムの多言語翻訳に特化しており、70以上の入力言語に対応し、13のターゲット言語へリアルタイムで出力できるほか、文字起こしテキストも同時に提供します。その対象となるユースケースには、カスタマーサポート、クロスボーダー販売、教育、イベント、そして世界中の視聴者を対象としたクリエイタープラットフォームなどが含まれます。

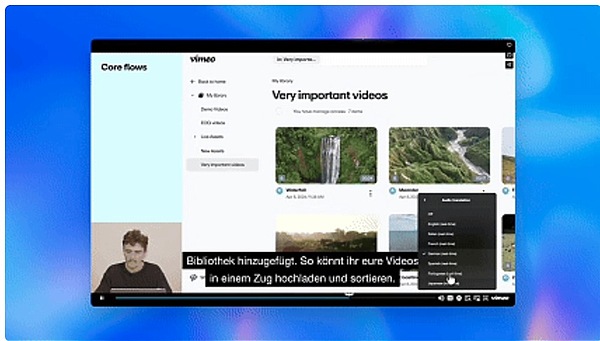

動画プラットフォームVimeoのAI責任者であるアルベルト・パラヴィチーニ(Alberto Parravicini)氏は、同社の活用事例について次のように語りました。動画再生時にGPT-Realtime-Translateを組み込むことで、クリエイターは動画を公開した瞬間から、世界中の視聴者と多言語でコミュニケーションをとることが可能になります。

VimeoによるGPT-Realtime-Translateのリアルタイム翻訳機能のデモ

GPT‑Realtime‑Whisperは、低遅延の文字起こしシーン向けに構築されたストリーミング音声認識モデルです。

話者が口を開いた瞬間に文字記録の生成を開始でき、会議のリアルタイム字幕、授業のノート、放送の字幕、および即座に後続のワークフローを生成する必要がある音声対話シーンに適しています。その中核的な価値は、会話の進行中に音声コンテンツを、下流の業務システムですぐに使用できる構造化テキストに変換できる点にあります。

セキュリティと価格

セキュリティ面において、Realtime APIは多層的な防護策を講じています。システムに組み込まれたアクティブ分類器が会話をリアルタイムで監視し、有害コンテンツガイドラインに違反するやり取りを検知した場合は、直ちに会話を終了させることができます。開発者は、Agents SDK を利用して、カスタムセキュリティガードを簡単に重ねて実装することもできます。

OpenAIの利用規約では、出力コンテンツをスパム、詐欺、またはその他の有害な目的で使用することを明確に禁止しています。

公式ガイドラインによると、対話相手がAIであることが対話状況から明確に示されていない限り、開発者はエンドユーザーに対して、AIと対話していることを明確に開示する必要があります(ユーザーへのヒント:現在話しているのはAIです)。さらに、このAPIはEUの顧客向けのEUデータレジデンシーを全面的にサポートしており、エンタープライズプライバシーコミットメントによって保護されています。

3つのモデルが、Realtime APIを通じて開発者に公開されました。

価格については、GPT‑Realtime‑2は音声トークン単位で課金され、入力トークン100万トークンあたり32ドル(キャッシュ入力は100万トークンあたり0.40ドル)、出力トークン100万トークンあたり64ドルです。GPT‑Realtime‑Translateは利用時間ベースで課金され、1分あたり0.034ドルです。GPT-Realtime-Whisperも同様に利用時間に基づいて課金され、1分あたり0.017ドルです。

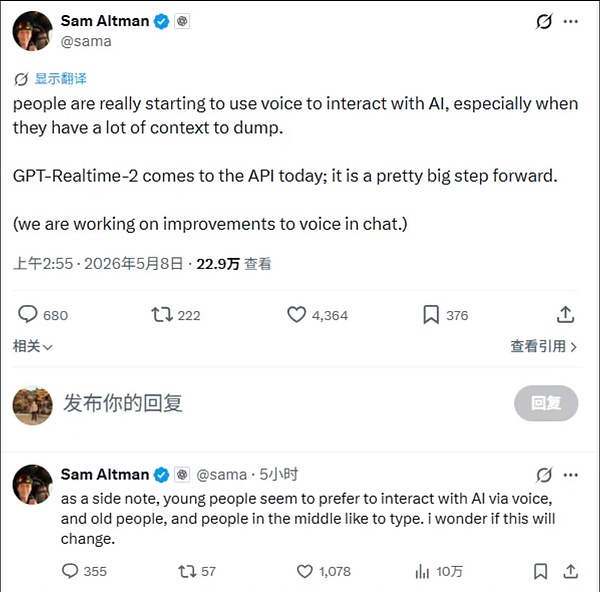

この新しい「音声サービス一式」を後押しするため、OpenAIのCEOサム・オットマン氏はXで次のように述べました:人々は確かに音声を使ってAIとやり取りし始めており、特に一度に大量の背景情報を伝える必要がある場合にその傾向が強い。

また、若年層は音声によるAIとのやり取りを好む傾向がある一方、中高年ユーザーはタイピングを好む傾向にあると指摘し、この習慣が将来変化するかどうかというオープンな問いを投げかけた。

ここで疑問が浮かびます。OpenAIが音声推論機能を新たに追加した今、次にバトンを受け取るのは誰になるのでしょうか?

Miyuki

Miyuki

Miyuki

Miyuki Brian

Brian Weiliang

Weiliang Miyuki

Miyuki Brian

Brian Weiliang

Weiliang Miyuki

Miyuki Alex

Alex Alex

Alex Alex

Alex