出典:DeepSeek公式サイト、翻訳:金色財経

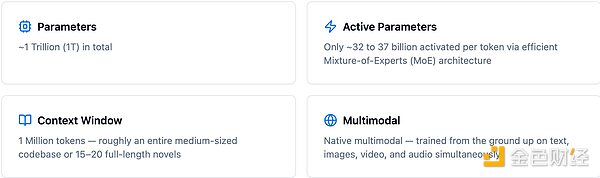

人工知能(AI)分野は今、大きな変革を迎えようとしている。DeepSeek V4は、DeepSeekが間もなくリリースするフラッグシップモデルであり、パラメータ数の限界を突破しただけでなく、これまでにない高効率なパフォーマンスを実現しています。このモデルは1兆(1T)のパラメータ数を有し、マルチモーダルをネイティブにサポート、100万トークンのコンテキストウィンドウを備えており、OpenAIのGPT-5.4やAnthropicのClaude Opus 4.5など、欧米のテック大手企業の製品と直接競合するものです。

本記事では、DeepSeek V4の主要な仕様、アーキテクチャの革新、予想価格、そしてその背景にある戦略的なハードウェア戦略の転換について、詳細に解説します。

主なポイント

MoEアーキテクチャを採用し、パラメータ数は1兆規模ですが、各トークンを処理する際にアクティブ化されるパラメータ数は約320億~370億にとどまります

100万トークンのコンテキストウィンドウは、長編小説15~20冊分のテキスト量に相当します

ネイティブなマルチモーダル機能:テキスト、画像、動画、音声処理を基盤レベルでサポート

API料金はGPT-5.4およびClaude Opus 4.5の1/10~1/50

モデルウェイトはApache 2.0オープンソースライセンスで公開予定

ローカル展開・実行可能:デュアルRTX 4090 GPUまたはシングルRTX 5090 GPUで対応可能

DeepSeek V4とは?

DeepSeek V4は、前世代製品(V3やR1など)の成功を基盤とし、超大規模な拡張性と極めて高い運用コスト効率を両立させています。主な技術仕様は以下の通りです:

3つの画期的なアーキテクチャの革新

DeepSeek V4の真の実力は、その強力な計算能力だけでなく、3つの具体的なアーキテクチャの革新にあり、これにより、1兆パラメータ規模のモデルのトレーニングと実行が可能となり、かつコストを管理できるようになりました。

1. Engram Conditional Memory

数百万トークンのコンテキストウィンドウにおいて最大の課題は、計算コストが急激に跳ね上がることなく、情報を正確に検索することです。DeepSeekはEngramアーキテクチャによってこの問題を解決しました。このシステムは、静的な事実(APIシグネチャや特定のパターンなど)と動的な推論を分離しています。

「Needle-in-a-Haystack」ベンチマークテスト(100万トークンの中から特定の事実を探す)において、Engramは精度を従来の84.2%から驚異的な97%へと大幅に向上させました。

2. マンフォルド制約超接続構造(mHC)

AIモデルの規模が拡大し続けるにつれ、モデルはトレーニングの不安定化(例えば勾配爆発)といった問題に直面しがちです。マンフォルド制約超接続構造(mHC)は、信号の増幅度を2倍以内に制限する数学的フレームワークです(対照的に、制約がない状態では3000倍に達する可能性があります)。

これにより、DeepSeekはわずか6.7%の計算コストで、1兆パラメータモデルのトレーニングを安定して完了させることが可能になります。

3. DeepSeek DSA メカニズムとライトニングインデクサー

100万トークンのコンテキストを効率的に処理するため、V4では従来の密なアテンションに代わって、疎なアテンションメカニズム(DSA)を採用しています。ライトニングインデクサーはコンテキストを高速にスキャンして関連する断片を特定し、モデルはこれらの特定のトークンセットに対してのみアテンション計算を実行すれば済みます。

長いコンテキストのシナリオにおいて、このアプローチにより計算コストを約50%削減できます。

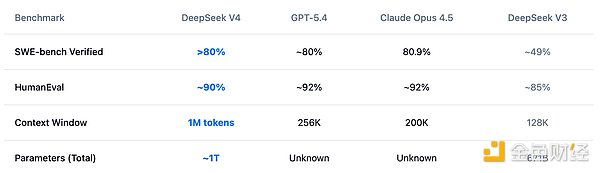

ベンチマーク比較:DeepSeek V4 vs GPT-5.4およびClaude 4.5

DeepSeek V4は、ソフトウェアエンジニアリングと深層推論能力に重点を置いています。内部ベンチマークデータによると、このモデルは極めて優れた性能を発揮しています。

注:これらのデータは現時点ではリークされた内部資料に基づいているため、モデルの正式リリース後は独立した第三者による検証を待つ必要があります。

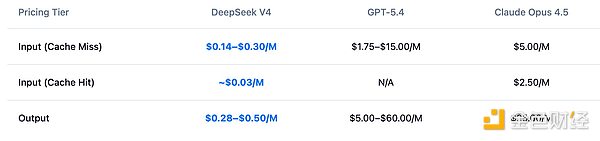

API 価格設定:最高のコストパフォーマンスを誇る最先端 AI

GPT-5.4 や Claude Opus などの欧米モデルは性能が優れていますが、利用コストが高額です。例えば、GPT-5.2/5.4 の入力トークン100万単位あたりの費用は約1.75~15.00ドル、Claude Opus 4.5 は100万単位あたり5.00ドルです。一方、DeepSeek V4の予想されるAPI価格は極めて画期的です:

これにより、同等の性能の場合、DeepSeek V4のコストは欧米の競合製品の約1/10から1/50となります。

地政学とハードウェア:ファーウェイのエコシステムへの転換

DeepSeek V4の最も影響力の大きい特徴の一つは、そのハードウェア基盤にある。米国がNVIDIAのハイエンドGPU(B300、H200など)に対して厳格な輸出規制を実施しているため、DeepSeekはV4を徹底的に最適化し、推論プロセスを主に中国国産チップで実行できるようにした。

モデルの初期トレーニング段階では依然としてNVIDIAのハードウェア(H800など)が使用されている可能性が高いものの、同モデルはHuawei Ascend 950PRおよびCambricon MLUチップに対して高度な最適化が施されている。

報道によると、ファーウェイのAscend 950PRの演算性能は、NVIDIA H20(現在、中国への輸出が合法的に許可されているチップ)の2.87倍に達する。これは、中国がAIチップの自主開発と制御を実現する道程における重要なマイルストーンとなる。

リリース時期:DeepSeek V4はいつ登場する?

DeepSeek V4は数度の延期を経てきた。当初は2026年2月中旬の旧正月の期間にリリースされるとの噂があったが、全く新しいハードウェアアーキテクチャ上でのトレーニングに伴う巨大な技術的課題により、リリース時期は延期された。

2026年3月9日、まだ正式に発表されていない「V4 Lite」バージョン(約2000億パラメータ)がDeepSeekプラットフォームに登場し、これによりコアアーキテクチャの実現可能性が事実上実証されました。

現在、1兆パラメータの完全版が2026年4月に正式リリースされると広く予想されている。

リリース後、DeepSeekはApache 2.0オープンソースライセンスを採用し、モデルの重みを公開する予定です。MoEアーキテクチャの効率性と量子化技術(INT8/INT4)のおかげで、この超大規模モデルは、デュアルRTX 4090グラフィックカードやシングルRTX 5090グラフィックカードなどのコンシューマー向けハードウェア上でローカルに実行できる見込みです。

DeepSeek V4 よくある質問

1. DeepSeek V4はChatGPT(GPT-5.4)よりも優れていますか?

内部ベンチマークの結果によると、複雑なソフトウェアエンジニアリングタスク(SWE-bench)やコードベースレベルのプログラミングタスクにおいて、DeepSeek V4のパフォーマンスはGPT-5.4やClaude 4.5に匹敵し、特に100万トークンのコンテキストウィンドウを活用することで、わずかに優位に立つことさえあります。ただし、このモデルが正式にリリースされた後も、絶対的な勝者を決定するには独立したテストが必要です。

2. DeepSeek V4をローカルで実行できますか?

はい、モデル重みが計画通りにオープンソース化されることを前提としています。MoEアーキテクチャは1回あたり約320億個のパラメータのみを活性化するため、量子化版(INT4)は理論上、32GBのVRAMを搭載したRTX 5090 1枚、またはRTX 4090を2枚搭載したシステム上でローカル実行が可能です。

3. DeepSeek V4のコストがこれほど低いのはなぜですか?

その低コストは、効率的なMoEアーキテクチャ(モデルの一部のパラメータのみを活性化)、低廉なトレーニングコスト(推定約1,000万ドル、対して欧米の同種モデルは1億ドルを超える)、および DeepSeek DSAメカニズムの適用——この技術により、長いコンテキストに必要な計算リソースが半減しました。

4. V4のいわゆる「ネイティブマルチモーダル」とは何を意味するのか?

初期のモデルが視覚プラグインをテキストモデルに「後付けで融合」させる手法とは異なり、V4はトレーニングの初期段階からテキスト、画像、動画、音声に基づいて同時並行で共同トレーニングを行います。これにより、手描きのアーキテクチャ図を分析して、対応するインターフェースコードを直接シームレスに生成するなど、より優れたクロスモーダル推論能力を備えています。

結論

DeepSeek V4は単なるマイナーアップデートではなく、アーキテクチャレベルでの画期的な進歩です。これは、インテリジェントな最適化(Engramメモリアーキテクチャ、mHC超接続構造、DSAメカニズム)を通じて、高コストでパラメータを無闇に増やす次元拡張手法に十分対抗できることを証明しています。

ネイティブなマルチモーダル機能、数百万トークンのコンテキストウィンドウ、そして画期的な価格戦略を武器に、DeepSeekは企業や個人開発者に、自社のAIインフラを見直すよう迫っています。APIとオープンソースのウェイトが2026年4月に予定通りリリースされれば、AI開発の全体的な構図は根本的な変革を迎えることになるでしょう。

JinseFinance

JinseFinance

JinseFinance

JinseFinance Sanya

Sanya JinseFinance

JinseFinance Bitcoinworld

Bitcoinworld Coindesk

Coindesk Cointelegraph

Cointelegraph Cointelegraph

Cointelegraph Cointelegraph

Cointelegraph Cointelegraph

Cointelegraph Cointelegraph

Cointelegraph