作者:苏扬,腾讯科技

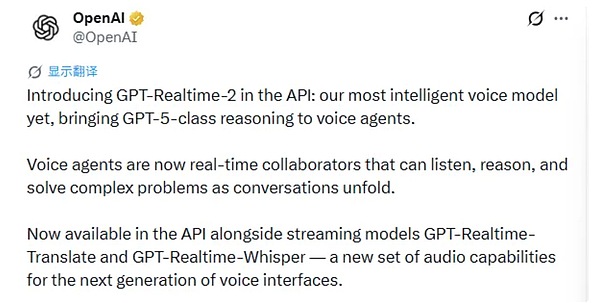

5月8日,OpenAI在API中加入三款新一代语音模型:主打语音推理与对话的GPT‑Realtime‑2、突出实时多语言翻译的Realtime‑Translate以及聚焦语音转文本的Realtime‑Whisper。

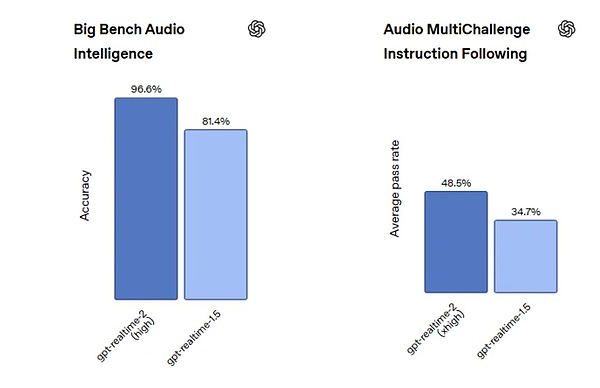

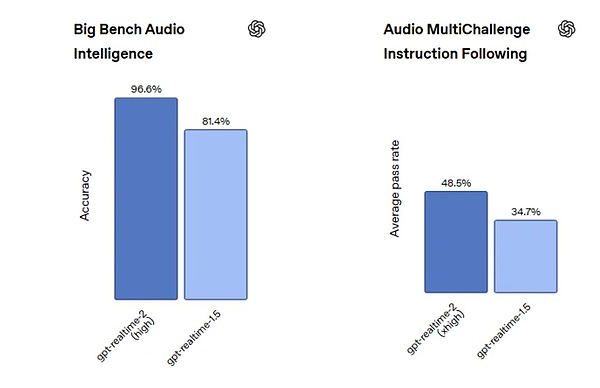

GPT‑Realtime‑2是OpenAI首个具备GPT‑5级别推理能力的语音模型。它在基准测试中展现出显著进步:在Big Bench Audio语音智能评估中的准确率达到96.6%,在Audio MultiChallenge指令遵循评估中的平均通过率为48.5%,分别较上一代GPT‑Realtime‑1.5提升15.2个和13.8个百分点。

基于GPT‑Realtime‑2,语音AI从简单的轮转式问答,向能够在对话展开过程中持续倾听、推理、调用工具并完成任务的形态进化。

会“想”的语音助手

GPT‑Realtime‑2的设计目标是让语音模型在保持对话流利度的同时,具备处理复杂事务所需的推理与行动能力。

在对话的自然度方面,模型引入了前导语机制。

开发者可以启用诸如“让我查一下”或“稍等,我正在查看”之类的简短提示语,在正式响应生成之前就告知用户请求已被接收并正在处理。

与此配套的是并行工具调用与工具透明性能力,模型可以同时调用多个外部工具,并通过语音向用户通报当前进度,例如说出“正在检查您的日历”或“正在查找”,使智能体在完成任务的过程中保持响应而非陷入沉默。

当遇到处理困难时,模型会主动给出诸如“我现在遇到点麻烦”的提示并尝试恢复,而非静默失败或直接中断会话。

此外,模型的上下文窗口从32K扩展至128K,这意味着它可以在更长、更复杂的多轮对话中保持连贯,支撑起更完整的智能体工作流。

在专业场景的适用性方面,模型增强了对特定领域术语的理解能力,能更准确地保留专业词汇、专有名词和医学术语,这对生产环境的部署价值突出。在表达层面,模型拥有更可控的语气和表现力,能够根据情境切换风格。

另一项关键升级是可调节的推理强度。开发者可以从minimal、low、medium、high和xhigh五个级别中进行选择(默认为low),以在延迟和推理深度之间取得平衡。

不唠闲嗑

GPT‑Realtime‑2在基准测试中完胜前代模型

在衡量语音模型中挑战性推理能力的Big Bench Audio评估中,GPT‑Realtime‑2(high推理级别)取得了96.6%的准确率,而GPT‑Realtime‑1.5为81.4%,提升幅度达到15.2个百分点。

在评估口语对话系统多轮交互智能的Audio MultiChallenge评测中——该评测涵盖指令遵循、上下文整合、自我一致性以及处理自然语音纠正等维度——GPT‑Realtime‑2(xhigh推理级别)的平均通过率从GPT‑Realtime‑1.5的34.7%跃升至48.5%,相对提升13.8个百分点。

事实上,衡量一个语音模型是否真正“聪明”,最有说服力的场景不是闲聊,而是处理一个需要层层推演的复杂问题。

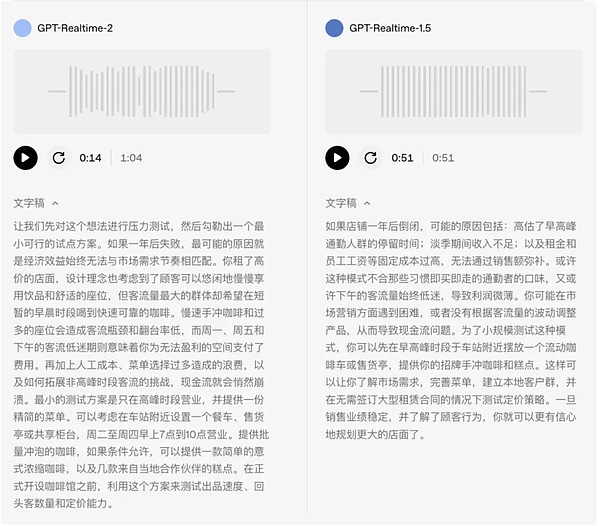

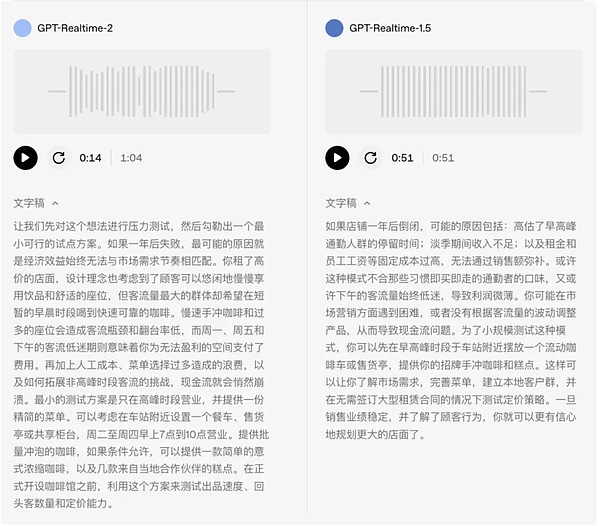

注:OpenAI在演示文档中给出了一个具体测试:用户向模型描述了自己的创业,两代Real time模型的语音推理及对应文字稿

上述案例属于一个对推理能力要求很高的复合型任务:模型需要同时理解多个变量的相互关系,客流的时间分布不均、昂贵的固定租金成本、以及主打慢冲咖啡这种翻台率偏低的业态定位,并在这些约束条件下进行逻辑推演。

GPT‑Realtime‑2用1分04秒给出了有条理、分层次的回答,不仅拆解了人流潮汐与租金结构之间的矛盾,指出高峰时段过于集中可能导致整体坪效不足以覆盖租金,还提出了具体的轻量级测试路径。

同样的提问交给上代模型GPT‑Realtime‑1.5,回应时长51秒,但深度明显不足。这个对比演示直接展示了两代模型在战略推理维度上的代际差距。

03 实时翻译与转录

除GPT‑Realtime‑2之外,OpenAI同期发布的两款专用模型各自面向明确的场景需求。

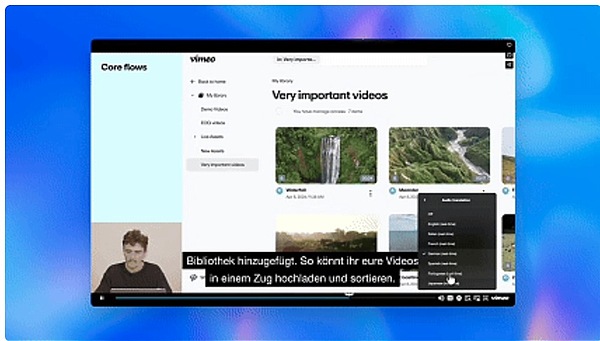

GPT‑Realtime‑Translate专注于实时多语言翻译,支持超过70种输入语言,可实时输出至13种目标语言,并同步提供转录文本。其目标应用场景包括客户支持、跨境销售、教育、活动以及面向全球受众的创作者平台。

视频平台Vimeo的AI负责人阿尔贝托·帕拉维奇尼(Alberto Parravicini)分享了他们的应用场景:在视频播放时嵌入GPT‑Realtime‑Translate,使创作者能够在上线瞬间就与全球观众进行跨语言沟通。

Vimeo演示GPT‑Realtime‑Translate实时翻译能力

GPT‑Realtime‑Whisper则是一款流式语音转文本模型,专为低延迟转录场景构建。

它能够在说话者开口的瞬间开始生成文字记录,适用于会议实时字幕、课堂笔记、广播字幕以及需要即时生成后续工作流的语音交互场景。其核心价值在于,将语音内容在对话进行过程中,即可转化为可供下游业务系统立即使用的结构化文本。

安全与定价

在安全层面,Realtime API部署了多层护栏——系统内置的主动分类器能够对会话进行实时监控,一旦识别出违反有害内容指南的交互,即可终止会话。开发者还可借助Agents SDK方便地叠加自定义安全护栏。

OpenAI的使用政策明确禁止将输出内容用于垃圾信息、欺诈或其他有害目的。

根据官方的指引,除非交互情境已清楚表明对话对象为AI,否则开发者必须向最终用户清晰地披露其正在与人工智能互动(提示用户:现在发言的是AI)。此外,该API已全面支持面向欧盟客户的欧盟数据驻留,并受企业隐私承诺保护。

三款模型现已通过Realtime API向开发者开放。

定价方面,GPT‑Realtime‑2按语音token计费,每100万输入token价格为32美元(缓存输入为每100万token 0.40美元),每100万输出token价格为64美元。GPT‑Realtime‑Translate按使用时长计费,每分钟0.034美元。GPT‑Realtime‑Whisper同样按时长计费,每分钟0.017美元。

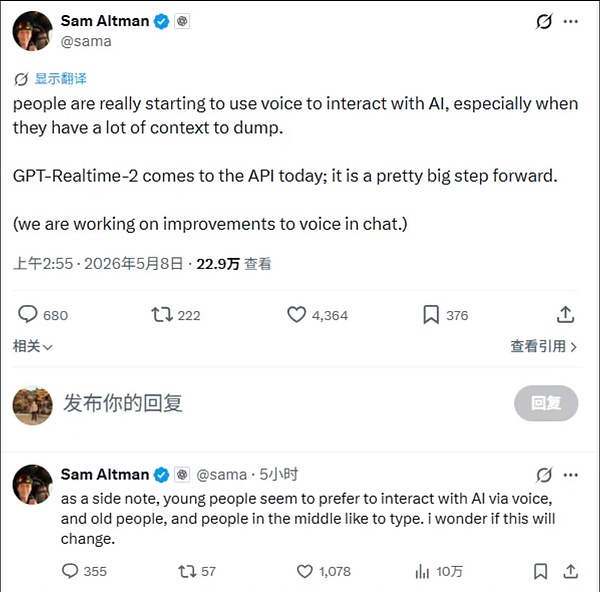

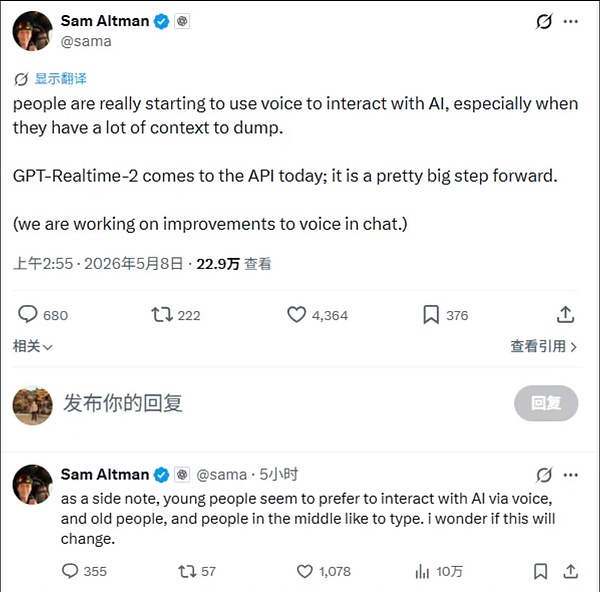

为了给新的“语音全家桶”背书,OpenAI首席执行官山姆·奥特曼在X上说:人们确实开始用语音与AI互动,尤其是在需要一次性倾注大量背景信息时。

他还提到,年轻人群体似乎更偏好通过语音与AI交流,而中老年用户则倾向于打字,并提出了这个习惯未来是否会变化的开放性问题。

问题来了:现在OpenAI的语音推理能力上新,下一个接力的会是谁?

Catherine

Catherine